Man har i allt större utsträckning börjat fundera på etiska frågor kring ny teknik. Vår förståelse för artificiell intelligens (AI) och de utmaningar som tekniken för med sig är dock ännu i barnskorna. Det är dags att använda fantasin och fråga oss vad vi vill ha av artificiell intelligens, hurdana lösningar vi ser som etiskt hållbara och hurdana beslut vi litar på att AI kan fatta.

Utmaningarna i diskussionen kring artificiell intelligens anknyter säkert delvis till dess komplexitet: vad talar vi ens om när vi talar om etik i artificiell intelligens? Å ena sidan kanske vi ser långt framåt mot möjliga tekniska och sociala utvecklingsriktningar samt genombrott i utvecklingen av AI. Å andra sidan talar vi också om sådant som redan är vardag, såsom utifrån vilka data reklambilder eller länkar till sidor visas på vår skärm. Artificiell intelligens är en problematisk term eftersom den är ganska inexakt.

Artificiell intelligens kan syfta på exempelvis neuronnätverk, maskininlärningsalgoritmer eller robotar. Det kan syfta på teknik som redan finns (så kallad svag eller snäv artificiell intelligens) och även på mer avancerad teknik. Stark artificiell intelligens syftar på artificiell intelligens som har förmåga till en bredare, flexibel intelligens. Tills vidare är all existerande AI-teknik svag artificiell intelligens. Jag använder artificiell intelligens som sammanfattande term för flera olika tekniker, såsom olika lärande algoritmer, robotik och föremålens internet (IoT).

Komplexiteten i diskussionen gäller inte bara de mångfasetterade termerna, utan också vår oförmåga att uppfatta framtidens komplicerade utvecklingsriktningar och deras förmåga att skära av varandra. Utvecklingen av AI-teknik påverkar redan nu vårt beteende, och vi kan anta att effekterna på samhällelig, social och psykologisk nivå kommer att vara betydande i framtiden.

När allt kommer omkring har vi inte någon särskilt bra uppfattning om hur långt effekterna kommer att sträcka sig eller hur vi kommer att förhålla oss till vår omgivning i en allt mer teknologiserad värld. Vår uppgift blir alltså att lägga fram mer eller mindre kvalificerade gissningar och önskemål om vad den nya tekniken ska föra med sig och vad det innebär för oss. Vi stöter redan nu på etiska problem i anknytning till AI-teknik, men när det gäller att hitta svar har vi ännu inte kommit särskilt långt.

Vems integritet, vems ansvar?

Alla, även barn och unga, har rätt till ett privatliv. Exempelvis våra smarttelefoner samlar hela tiden in information om oss utan att vi märker det, och ofta utan något särskilt samtycke från vår sida. I Kina går allt fler barn med en smartklocka på armen. Artificiell intelligens gör det allt lättare att samla in personlig information, och dessa massor av information koncentreras till stora privata aktörer. Profileringen samt övervakningen och förutseendet av människors agerande blir allt exaktare. Det är svårt för oss att bedöma vad den information som samlas in om oss används till. Informationsmassorna är inte heller, ens i bästa fall, helt skyddade mot utomstående attacker.

Och så var det frågan om samtycke. För dem som arbetar med artificiell intelligens är det inte nödvändigtvis självklart att vi uppfattar de bilder vi laddar upp i sociala medier som våra egna. Det syfte som vi laddar upp bilderna för är inte nödvändigtvis det enda de används för. Samtidigt verkar valfriheten i fråga om att ge sitt samtycke till exempelvis en sociala medier-app ganska skenbar, om hela kompiskretsen samlas kring appen i fråga. Har vi alltså avstått från vår rätt till ett privatliv när vi laddar ner en app?

När tekniken utvecklas krävs allt mer transparens och ansvar. Det är viktigt att AI-teknikens logik lätt kan göras tydlig även för dem som inte vet så mycket om teknik. Vi måste trygga den teknologiska jämlikheten och komma ihåg att mindre erfarna användare – såsom unga – är i en mer sårbar ställning än andra.

Hur kan data diskriminera?

Vi vet att människor kan vara opålitliga och diskriminerande i sina beslut, så många kanske redan har dragit en suck av lättnad – datorn agerar åtminstone pålitligt och jämlikt! Man tänker lätt att matematik och data är objektiva. Det faktum att siffror, algoritmer och data bara skapar en illusion av objektivitet kan utgöra ett problem.

När informationsmassor och artificiell intelligens kan användas för att öka användningen av information i beslutsfattande, bör man minnas att beslut aldrig är neutrala eller helt objektiva. Det är också viktigt att inse att de matematiska modeller som artificiell intelligens använder och producerar alltid är osäkra i någon mån. Bedömningar av informationens kvalitet och representativitet blir centrala.

Algoritmer och data kan vara förvrängda på olika sätt. De övningsdata som används av en algoritm kan vara skeva för att någon befolkningsgrupp är under- eller överrepresenterad, vilket leder till ett diskriminerande slutresultat. Här döljer sig också en möjlighet som artificiell intelligens ger: sådana här algoritmer kan användas för att avslöja diskriminerande strukturer i samhället. Algoritmer kan å andra sidan vara snedvridna i den meningen att de uttrycker kodarens värderingar.

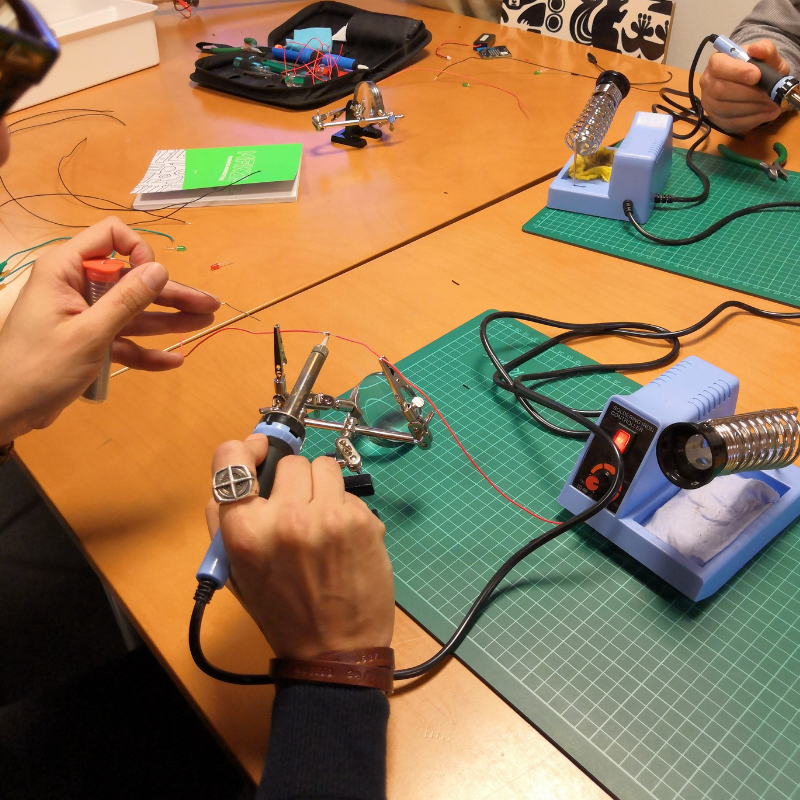

Diversitet är också viktigt i den tekniska utvecklingen. Kvinnor är underrepresenterade i tekniksektorn i allmänhet, och inom maskininlärning är skevheten ännu större. Även könsminoriteter och sexuella minoriteter, etniska minoriteter samt olika yrkesgrupper kunde gärna vara bättre representerade. Det finns alltså hopp i de unga, och teknologifostran har en betydande roll i att väcka intresse för AI-teknik och teknologisk läskunnighet.

Mänsklighet vid sidan av AI

När vi talar om etik i artificiell intelligens är det bra att komma ihåg att AI-teknik inte bara är (hjälp)medel. Medlen blir en del av vår kultur och kommunikation, och vi bör också fokusera på hur tekniken används. Det är inte heller längre självklart att människan styr maskinen. Datorerna och algoritmerna styr också oss.

För att livet med artificiell intelligens ska vara mänskligt måste vi utveckla tekniken med hänsyn till möjligheterna till ett gott liv. Artificiell intelligens kan vara till hjälp i skötseln av rutinuppgifter inom social- och hälsovården. Då blir det mer tid över för att möta människorna. Om man skär ner resurserna kan denna väg dock även vara bedräglig. Om rutinarbetet sköts med artificiell intelligens, vem avgör hur mycket mänsklig kontakt exempelvis en sängliggande åldring behöver? Hur kommer omsorgen att fördelas i framtiden, hur kommer vårdtagarna att förhålla sig till tekniska hjälpmedel och vilka möjligheter till autonomi och förhandling kommer de att ha?

Vår moraluppfattning och vårt liv i samhället bygger på interaktion och empati. Vi delar också information om varandra samt straffar och belönar varandra utifrån våra handlingar. Det moraliska ryktet har en central roll när vi väljer vem vi vill samarbeta med. Hurdant rykte kan vi ge en artificiell intelligens, som i sig själv saknar moral? Vem får ansvaret i etiskt svåra situationer, där en artificiell intelligens har fattat ett beslut? Om ansvaret hamnar i ingenmansland kan det bryta ner vårt förtroende för varandra och det omgivande samhället.

Vi kanske distanserar oss från beslutsfattandet, men samtidigt blir den moraliska tolkningen av problematiska lösningar kvar hos oss människor – även i situationer där vi inte har förstått att vi har en ansvarsställning. Samtidigt behöver vi ha empatifärdigheter och förmåga att sätta oss in i andras situation.

Mot framtiden

Redan i början tog jag upp våra problem med att föreställa oss saker. Hur svårt det är att förutse framtiden. Vi står dock redan inför frågor som vi behöver uppmärksamma när AI får allt större fotfäste. På vilka grunder väljs vi ut för en arbetsintervju? Och hur synliggörs reklam, nyheter och diskussioner för oss i sociala medier? Hur påverkar de omtalade bubblorna diskrimineringen av utomstående grupper, våra empatiska färdigheter, våra värderingar och våra sätt att påverka i samhället? Å andra sidan kan man också fråga sig hur man kan använda artificiell intelligens för att främja demokratin och medborgarsamhället.

Det är också bra att komma ihåg att tekniken inte utvecklas på ett jämlikt sätt av sig själv. För vilka intressen utvecklas AI? Hur formar tekniken våra miljöer och observationer? Vilka gynnas av tekniken, och hurdana värderingar skapar den? Teknik kan se väldigt olika ut på olika håll i världen. Det som genomsnittsfinländaren betraktar som etiskt förkastligt kan vara mer accepterat i Ryssland, Kina eller USA, eller tvärtom. I en global värld är det svårt att kontrollera utvecklingen, och att exempelvis utforma gemensamma etiska principer för artificiell intelligens är en verklig utmaning.

I utvecklingen av AI-teknik utvecklar vi nya sociala normer och gränser för mänskligheten, som speglas mot det förgångna. Vi måste se till att alla har möjlighet att vara delaktiga i utvecklingen, men samtidigt ge dem möjlighet att värna om sin autonomi och integritet separat från tekniken. Knivigt, eller hur? Det är bra att utmana antagandet om unga som diginativa och stödja dem i sociala relationer, empatifärdigheter och stärkande av den etiska kompassen när AI utvecklas.